👁🗨 “Où est papa ?” Le système d’IA meurtrier d’Israël

Lorsque la poussière retombera sur Gaza, les historiens réaliseront quelle machine a donné les ordres. Where's Daddy ?, la machine qui fait de l'heure du coucher un champ de bataille. Qui tue l'amour.

👁🗨 “Où est papa ?” Le système d’IA meurtrier d’Israël

Par Mk Sensei, le 25 mai 2025

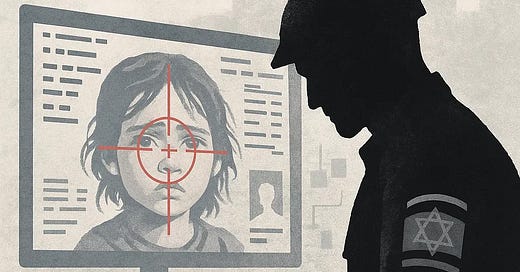

Comment le système d'IA d'Israël a transformé les liens familiaux en coordonnées de ciblage à Gaza.

I-Le code derrière le carnage

Alors que les missiles pleuvent sur Gaza et que les immeubles s'effondrent, une guerre silencieuse se déroule derrière les écrans lumineux et les serveurs clignotants des centres de commandement militaire israéliens. Le logiciel au cœur de cette guerre porte un nom inquiétant : Where's Daddy ?

Développé par l'unité 8200, l'élite des services du renseignement militaire israélien, Where's Daddy ? n'est même pas mentionné dans le discours officiel. Mais à la suite de l'offensive génocidaire d'Israël à Gaza, où plus de 67 000 Palestiniens sont tombés en date de mai 2025, dont plus de 70 % de femmes et d'enfants, ce système alimenté par l'IA a émergé comme l'une des technologies les plus effrayantes de la guerre moderne.

Créé à l'origine dans le cadre de l'architecture de surveillance par fusion de données d'Israël, Where's Daddy ? utilise des métadonnées, la reconnaissance de schémas et le profilage comportemental pour tracer les mouvements des hommes palestiniens, en particulier ceux considérés comme étant “en âge de combattre”, sur la base de leurs interactions familiales. En identifiant quand et où un père est susceptible d'aller voir ses enfants, le système signale à l'armée de l'air israélienne qu'il y a une “opportunité de frappe” En termes plus simples : on attend qu'il rentre chez lui pour embrasser son enfant, puis on bombarde la maison.

II-A Le piège numérique : comment fonctionne Where's Daddy ?

Selon des témoignages divulgués par des agents des services de renseignement israéliens et corroborés par les enquêtes du magazine +972 et de Local Call, Where's Daddy ? fonctionne en fusionnant les données de surveillance provenant de multiples plateformes : interceptions de communications cellulaires, images satellite, vidéos de drones et profilage biométrique. Grâce à un apprentissage automatique, le système crée des modèles probabilistes : où la cible est-elle susceptible de se trouver à 18 heures ? Qui va-t-elle voir pour l'Aïd ? Quelle est la meilleure occasion de frapper sans “gaspiller” de missiles ?

Le nom, qui aurait été inventé par un analyste de l'Unité 8200, n'est pas seulement une requête algorithmique. C'est une philosophie de guerre. Les enfants sont l'appât. Les maisons les pièges. La famille la faille fatale.

Un ancien officier israélien a révélé que durant les premières phases de l'invasion terrestre,

“nous attendions qu'un père rentre chez lui. Une fois qu'il était entré, nous donnions le feu vert pour l'attaque”.

Dans une déclaration distincte, une source de l'armée de l'air a décrit comment le système “Optimise les créneaux de mise à mort” en fonction de ces retours, souvent autour de l'heure du dîner.

L'efficacité macabre de ce modèle s'apparente à ce qu'on appelle la police prédictive à outrance. Sauf qu'à Gaza, être la mauvaise personne au mauvais moment ne signifie pas être arrêté, mais être anéanti.

III-La machine de mise à mort de l'IA à grande échelle

Where's Daddy ? n'est pas un cas isolé. Il fonctionne comme une composante d'un réseau plus vaste de systèmes de guerre autonomes et semi-autonomes en Israël.

Ces systèmes d'IA — Lavender, Where's Daddy ?, Habsora (The Gospel), Gospel Plus et Fire Factory — ne fonctionnent pas de manière isolée.

Ils constituent plutôt une infrastructure intégrée de surveillance, de ciblage et d'anéantissement. Ils œuvrent de concert, transmettant données et décisions via un réseau interconnecté, où le contrôle humain se réduit à une simple validation. Il ne s'agit pas seulement d'une guerre. Il s'agit d'une extermination algorithmique.

A. Lavender : le générateur de listes de personnes à abattre

Au cœur de la chaîne meurtrière de l'IA israélienne se trouve Lavender, un outil doté d'une intelligence artificielle développé par les services du renseignement militaire israéliens.

Lavender fonctionne comme un moteur de profilage alimenté par l'IA qui passe au crible d'énormes quantités de données de surveillance – métadonnées, enregistrements téléphoniques, réseaux sociaux, modèles comportementaux et associations non vérifiées – afin de générer un “score de mise à mort” des hommes palestiniens. Une fois un seuil atteint, Lavender signale automatiquement l'individu comme devant être assassiné. Selon des rapports d'enquête, des dizaines de milliers de noms sont passés par ce système. Dans la pratique, des soldats subalternes, souvent âgés d'une vingtaine d'années, approuvent plus de 100 ordres d'assassinat par jour sur la seule base des suggestions automatisées de Lavender. Comme l'a décrit un initié :

“Vous n'avez pas besoin de vérifier. S'il est dans Lavender, c'est un terroriste”.

On ne conteste pas la décision. Il n'y a pas de confirmation. Pas de vérification par les services du renseignement. L'algorithme devient juge, jury et, par procuration, bourreau.

B. Where's Daddy ? Le timing parfait pour instaurer la terreur psychologique

Une fois que Lavender a identifié qui doit mourir, Where's Daddy ? détermine quand. Ce système, également alimenté par l'IA, cartographie les habitudes et déplacements des personnes ciblées. Sa fonction principale est de synchroniser les frappes aériennes afin d'avoir un impact psychologique et civil maximal. Si la personne ciblée est chez elle avec sa famille, en particulier avec des enfants, Where's Daddy ? donne le feu vert à l'opération.

L'objectif n'est pas seulement l'assassinat, mais aussi le traumatisme collectif des civils. Des familles entières sont rayées de la carte en quelques secondes, dans le but glaçant d'envoyer un message politique : personne n'est en sécurité, pas même sous son propre toit.

Lavender choisit qui doit mourir, Where's Daddy ? choisit le moment où l'impact est maximal.

C. Habsora (L'Évangile) : le moteur relationnel

Habsora, qui signifie “Évangile” en hébreu, est un autre maillon clé de cette machine de guerre IA. Il fonctionne comme un moteur de cartographie relationnelle, analysant les réseaux d'associations entre les individus. Le système analyse rapidement les données de surveillance afin d'identifier des cibles potentielles, notamment des bâtiments, des équipements et des individus soupçonnés d'appartenir au Hamas ou au Jihad islamique. Selon des sources militaires, Habsora a considérablement accéléré l'identification des cibles, passant d'environ 50 cibles par an à 100 cibles par jour durant le récent génocide. À l'aide de métadonnées et de renseignements géospatiaux, Habsora marque les individus socialement ou géographiquement proches des cibles existantes. Cette approche élargit considérablement le champ d'action des assassinats, bien au-delà des critères traditionnels des services du renseignement militaire. En substance, Habsora transforme la proximité en arme. Habsora a permis de mener des campagnes de bombardements à grande échelle, des quartiers résidentiels entiers étant marqués pour être frappés sur la base de probabilités générées par l'IA plutôt que de menaces confirmées.

D. Gospel Plus : le générateur de précédents

L'arme la plus récente de cet arsenal est Gospel Plus, un système d'IA qui analyse les opérations militaires passées à l'aide du deep learning. Son rôle est d'évaluer la “faisabilité” d'un assassinat, en tirant parti des actions passées d'Israël pour prédire les actions futures possibles. Ce système crée un modèle de justification basé sur les données. Si une frappe similaire n'a pas suscité de réaction internationale dans le passé, Gospel Plus la recommandera à nouveau. Les précédents juridiques sont remplacés par une reconnaissance des schémas militaires. Les crimes de guerre deviennent alors des points de données dans un algorithme.

E. Fire Factory : La calculatrice de destruction

Une fois la cible et le moment choisis, Fire Factory s'occupe de la logistique. Ce système calcule le nombre et la taille des bombes nécessaires pour détruire un bâtiment ou un quartier spécifique. Il met ensuite ces bombes en attente pour qu'elles soient automatiquement larguées par des drones ou des avions de combat. Fire Factory ne se soucie pas de savoir qui se trouve à l'intérieur du bâtiment. Ses données sont purement structurelles : tonnage, rayon de l'explosion, dynamique de l'effondrement. Il s'agit d'un pur outil de démolition, utilisé même lorsque des civils sont encore piégés à l'intérieur. Comme l'a admis un officier des services de renseignement israéliens :

“La machine propose. L'humainvalide. Puis la bombe est larguée”.

Mais même cette “validation” est en grande partie automatisée. Les cibles générées par IA sont préautorisées en masse. La supervision humaine est sommaire, souvent purement procédurale. Il en résulte un système où la responsabilité est dissoute dans le code et où les décisions autrefois chargées d'un poids moral sont transférées aux machines.

C'est ce qu'un lanceur d'alerte a qualifié de “meurtre industriel”.

La boucle : comment tout cela fonctionne ensemble

Lavender attribue une note à chaque individu en fonction de sa probabilité d'être tué. [Qui]

Where's Daddy ? suit leurs mouvements et sélectionne le moment le plus “propice” pour frapper. [Quand]

Habsora The Gospel identifie les bâtiments et les installations prétendument utilisés par les militants. [Où]

Gospel Plus justifie le meurtre à l'aide de données issues de frappes passées. [Contexte]

Fire Factory planifie et exécute la destruction proprement dite. [Comment]

IV-Le coût humain : les civils victimes collatérales

L'une des utilisations les plus effroyables de Where's Daddy ? a été son rôle dans le ciblage de zones civiles à forte densité. Selon certaines informations, le système inclut explicitement “les enfants à la maison” dans les variables calculées.

“La présence d'enfants n'est pas un facteur dissuasif”, a déclaré une source. “C'est parfois même le but recherché. Parce que nous savons que c'est à ce moment-là que la cible sera là”.

Cette stratégie a atteint son paroxysme dans les camps de réfugiés de Jabaliya et d'al-Bureij, où des familles entières ont été incinérées parce que les pères étaient censés être à la maison après le couvre-feu. Un cas cité par le ministère palestinien de la Santé concerne une famille de neuf personnes, toutes tuées lorsqu'une bombe d'une tonne a rasé leur appartement à 19 h 42, précisément à l'heure où le père rentrait du marché.

Dans un autre cas, un agent de la protection civile très connu a été tué avec ses filles alors qu'ils regardaient la télévision. Son “mode de vie”, suivi grâce à son téléphone portable, montrait qu'il rentrait chez lui tous les soirs à la même heure. Ce n'était pas un combattant, mais un ambulancier.

Le résultat ? Des centaines d'enfants tués, pas par accident, mais de manière délibérée.

V-De la surveillance à l'extermination

Where’s Daddy ? incarne l'instrumentalisation de la vie elle-même. Alors que le ciblage traditionnel repose sur les services du renseignement, ce système s'appuie sur les habitudes. Il tue non pas en fonction de ce que fait une personne, mais en fonction de qui elle est, où elle va, qui elle aime.

Il marque ainsi une évolution terrifiante dans la guerre numérique. Il abolit la distinction entre surveillance et exécution. L'amour d'un père devient le déclencheur de l'algorithme. Une étreinte fait office de preuve.

Les autorités israéliennes nient que Where's Daddy ? vise des civils. Mais leur silence sur l'existence du système, malgré les témoignages qui s'accumulent, en dit long. Tout comme leur refus de divulguer les registres de ciblage, les motifs des frappes ou les analyses post-mortem. La transparence, dans cette guerre, fait des victimes.

VI-Effondrement éthique et impunité juridique

Les défenseurs des droits humains avertissent que l'opération Where's Daddy ? peut constituer une violation du droit international.

“Le ciblage délibéré de civils à l'aide de modèles prévisionnels basés sur les habitudes familiales équivaut à un meurtre prémédité”,

a déclaré le Dr Kareem Ahmed, spécialiste du droit de la guerre à l'université SOAS de Londres.

L'utilisation de l'IA à cette fin porte également atteinte au principe de distinction inscrit dans les Conventions de Genève.

“Ce ne sont pas des erreurs. Ce sont des caractéristiques”, a ajouté Ahmed. “Le système est conçu pour exploiter les aspects les plus humains de la vie – les liens, la parenté, la routine – comme vecteurs de mort”.

Selon les juristes, Israël pourrait être accusé de crimes de guerre si des preuves sont mises au jour. Mais avec un système entouré du plus grand secret et un accès restreint aux médias, la justice pourrait rester aussi lointaine que l'horizon défiguré de Gaza.

VII- Une guerre de relations publiques : une déshumanisation planifiée

Alors que Where's Daddy ? ravageles foyers, les responsables israéliens ont lancé une campagne médiatique mondiale avec des slogans tels que “Ramenez-les chez eux” et “Nous ciblons le Hamas, pas les familles”. Contraste saisissant.

La propagande présente chaque école bombardée comme un “centre de commandement du Hamas”. Chaque appartement détruit est un “nid de terroristes”. Pourtant, la philosophie sous-jacente à ces attaques est toute autre. Il ne s'agit pas seulement d'éliminer les membres du Hamas, mais de détruire les structures mêmes qui permettent aux Palestiniens de vivre, d'être ensemble et de se sentir en sécurité.

Et rien ne le montre plus clairement que Where's Daddy ?, un intitulé qui se moque du chagrin et réduit la recherche d'un enfant à un GPS de traque.

VIII- Étape suivante : une guerre d'IA sans témoins

Alors qu'Israël renforce son infrastructure technologique et externalise le ciblage à des réseaux névralgiques et à des prestataires privés, nombreux sont ceux qui craignent que cette guerre n'ait révélé l'avenir des conflits armés : opaques, automatisés et totalement dépourvus d'humanité.

“Ce que Where's Daddy ? nous a montré”, a déclaré un ancien technicien de l'armée israélienne qui a fui Israël en signe de protestation, “c'est qu'il n'est pas nécessaire de voir son ennemi. Il suffit de connaître ses habitudes. Et une fois que vous connaissez ses habitudes, l’humain disparaît”.

C'est sans doute la vérité la plus terrifiante de toutes.

Lorsque la poussière retombera sur Gaza, si jamais elle retombe, les historiens ne se demanderont pas seulement qui a donné les ordres, mais quelle machine a conçu la liste. Dans ce génocide par métadonnées, Where's Daddy ? est plus qu'un accessoire. C'est l'arme.

Une machine qui transforme l'heure du coucher en champ de bataille.

Qui tue l'amour.

Et qui demande, avec une précision impitoyable : Where's Daddy ?

Et qui demande, avec une précision impitoyable : Where's Daddy ?

Traduit par Spirit of Free Speech

Références :

1- https://www.accessnow.org/publication/artificial-genocidal-intelligence-israel-gaza/

2- https://www.aa.com.tr/en/europe/eu-funding-for-israeli-tech-raises-fresh-concerns-of-complicity-in-genocide/3444314

3- https://verfassungsblog.de/gaza-artificial-intelligence-and-kill-lists/

4- https://www.techpolicy.press/when-algorithms-decide-who-is-a-target-idfs-use-of-ai-in-gaza/

5- https://www.972mag.com/mass-assassination-factory-israel-calculated-bombing-gaza/

6- https://www.972mag.com/lavender-ai-israeli-army-gaza/

7- https://www.hrw.org/news/2024/09/10/questions-and-answers-israeli-militarys-use-digital-tools-gaza

8- https://www.ohchr.org/en/press-releases/2024/04/gaza-un-experts-deplore-use-purported-ai-commit-domicide-gaza-call

9- https://theconversation.com/gaza-war-israel-using-ai-to-identify-human-targets-raising-fears-that-innocents-are-being-caught-in-the-net-227422

Je suis quasi-certain que ces 'joujoux' immondes seront en vente car ils interessent sûrement les responsables européens en vue du futur univers carcéral qu’ils nous préparent...Retailleau ne serait pas contre à substituer la mollesse de ses troupes de choc par des cyber-flics ou robocops tueurs programmés pour tuer tout dissident pro-russe, complotiste, islamo-gauchiste, ....(rayez les mentions inutile).

Écœurant...La machine sionazie représente la part la plus hideuse de l’humanité. La technologie au service de la barbarie portée au plus haut degré de linfâmie.